国产算力和国产大模型,迎来双赢时刻

国产算力和国产大模型,迎来双赢时刻星火语音大模型诞生的意义,不仅仅是成为更高效和智能的生产力,科大讯飞的判断是,语音交互,能加速万物互联时代的到来。

星火语音大模型诞生的意义,不仅仅是成为更高效和智能的生产力,科大讯飞的判断是,语音交互,能加速万物互联时代的到来。

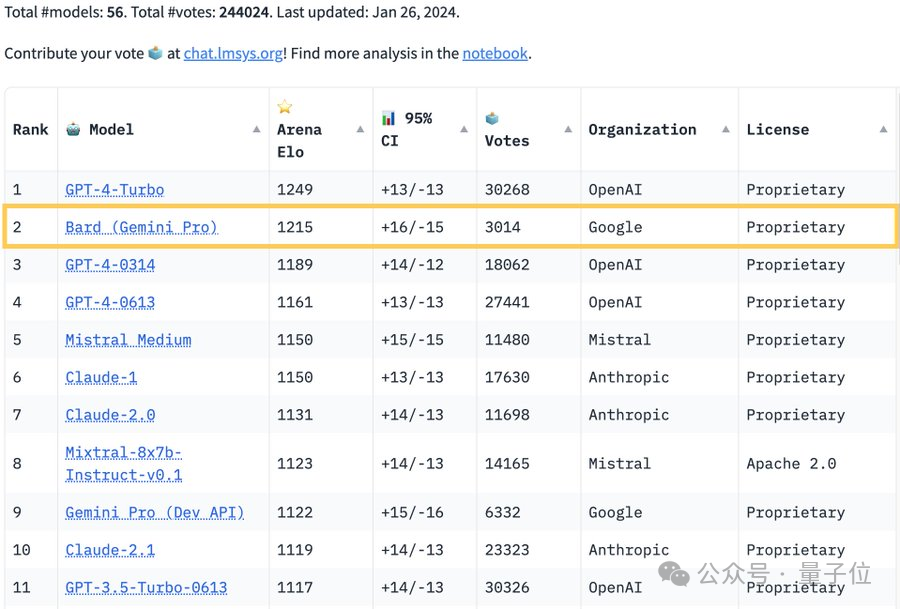

“大模型排位赛”权威榜单Chatbot Arena刷新:谷歌Bard超越GPT-4,排名位居第二,仅次于GPT-4 Turbo。

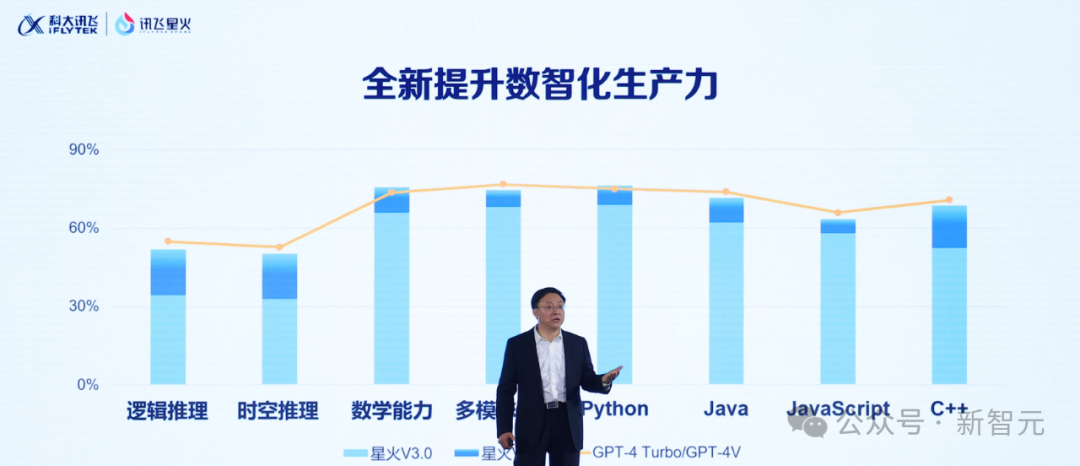

首个基于全国产化算力平台「飞星一号」的大模型,正式开源!

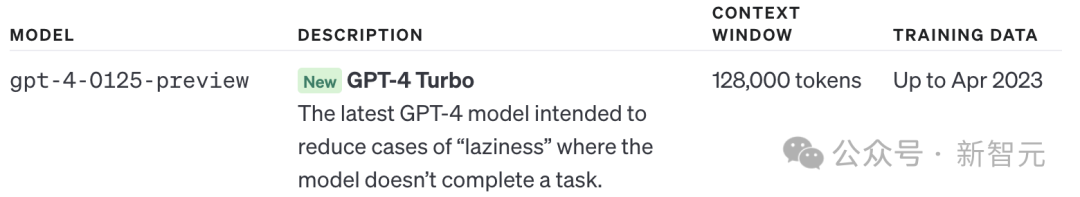

OpenAI 在一篇博文中发布了多项更新,并表示更新后的 GPT-4 Turbo“拥有比之前预览模型更好的代码生成等能力,且减少了模型在任务中途罢工的「变懒」情况。”但该公司并没有对更新内容做进一步解释。

全新GPT-4 Turbo预览模型据介绍,该模型能更完整彻底地完成代码生成等任务,以减少模型未完成任务的“惰性”情况。

昨夜,OpenAI一口气连更5款新模型。GPT-4 Turbo变懒问题修复,代码生成能力史诗级加强。另外,多款模型价格大幅暴降。

2013 年创立的科技产品发现平台 Product Hunt 如今已经成为发现新的 AI 产品的主要平台,里面聚集了大量 Early Adopters 种子用户。Notion、Framer 和 Loom 等等产品都通过 Product Hunt 成功实现了冷启动。

AI训AI必将成为一大趋势。Meta和NYU团队提出让大模型「自我奖励」的方法,让Llama2一举击败GPT-4 0613、Claude 2、Gemini Pro领先模型。

OpenAI 宣布,正式开放 GPT3.5 微调 API,并承诺 2023 年内推出 GPT-4 微调 API。

不知不觉,LangChain 已经问世一年了。作为一个开源框架,LangChain 提供了构建基于大模型的 AI 应用所需的模块和工具,大大降低了 AI 应用开发的门槛,使得任何人都可以基于 GPT-4 等大模型构建自己的创意应用。